来源:长安街知事微信公号

最近,福建三明永安一起“保安与女司机肢体冲突”的事件引发关注,原本只是因停车纠纷引发的普通治安案件,后续却被人用AI把两位当事人剪辑成“和好接吻”“当场求婚”等离谱视频。这些内容引人反感,却因技术加持而真假难辨,迅速扩散。

这场AI滥用事件并非个例。此前,奥运冠军全红婵的声音被AI仿冒用于带货土鸡蛋,售出4.7万件,大量粉丝误以为是本人直播。其家人无奈表示,“那是AI声音,全平台一大堆这样的切片,告都告不过来。”

与此同时,部分平台不乏“林黛玉倒拔垂杨柳”“西门庆怒揍潘金莲”“孙悟空大战奥特曼”等魔改内容,一些低质的“激光大战版《三国演义》”甚至让一些中小学生欲罢不能。

“AI魔改”下《三国演义》和《西游记》的混搭。图源:“中国日报双语新闻”微信公众号

AI在重塑内容生产逻辑的同时,也在重塑网络生态风险结构,让创作更容易,也让造假更便利。

看起来像真的,往往就被当成真的

不可否认,生成式AI显著降低了创作门槛。过去需要团队完成的视频、插画、配音,如今个人借助工具即可实现,内容生产效率大幅提升,表达边界不断拓展。

但与此同时,低成本复制、批量化生产与情绪化叙事快速泛滥。2025年底,“slop”(数字泔水)被评为年度热词,专指由AI批量生成的低质量内容,“数字泔水”已成为全球性治理难题。

一方面,生成式AI极大压缩了内容生产成本,使“造假”与“拼接”几乎无门槛;另一方面,平台的流量分发机制天然偏好冲突性强、情绪浓度高的内容,而AI恰恰擅长生成此类信息。当“低成本生产”叠加“高回报激励”,大量结构雷同却极具传播力的内容得以极速扩散。

此外,AI的仿真能力正在突破普通用户的辨识阈值,尤其是青少年与老年群体,在信息判断上更易受到误导。“看起来像真的”,往往就被当成真的。这种认知错位,使AI内容治理呈现出长期性与复杂性。

上述均为AI制作。图源:社交平台

从补漏洞到建机制

正是在上述背景下,我国AI内容治理正从阶段性整治迈向制度化构建,一系列制度安排密集出台:

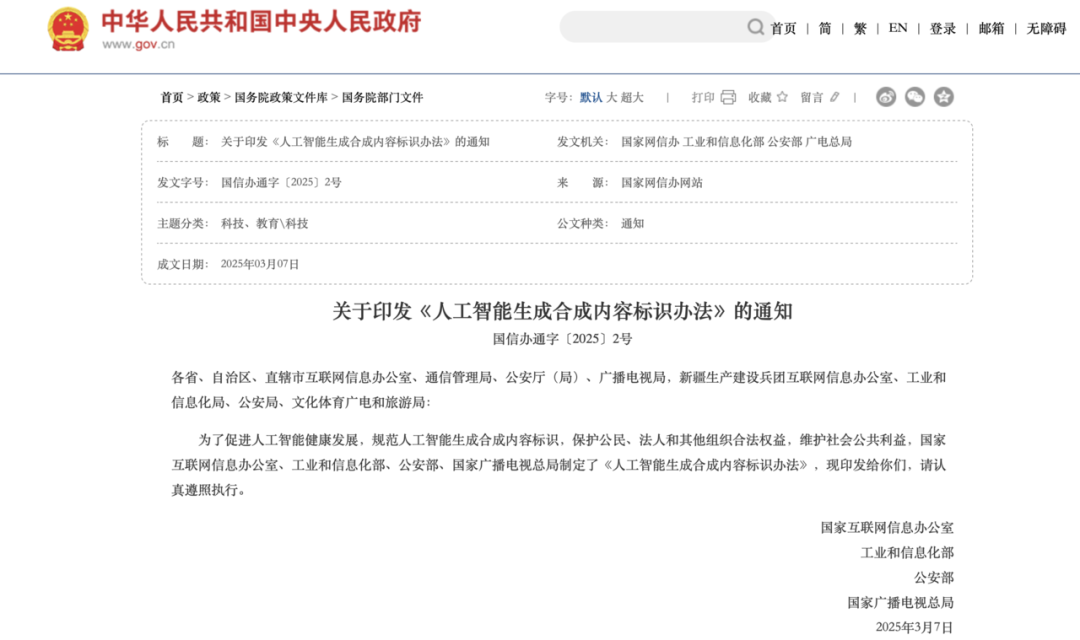

2025年9月施行的《人工智能生成合成内容标识办法》,明确要求所有AI生成的文本、图片、音频与视频必须进行显著标识,以保障公众对信息来源的知情权;

关于印发《人工智能生成合成内容标识办法》的通知 图源:网页截图

2026年施行的新修订《中华人民共和国网络安全法》进一步强化了平台在AI内容治理中的主体责任;

中央网信办今年持续推进“清朗”系列专项行动,多次将整治“数字泔水”、打击AI造假列为重点任务。仅在2026年2月的一次集中整治中,就处置账号3.9万余个,清理违法违规信息超过70万条,国家广播电视总局针对“AI魔改”视频的专项治理也清理相关内容2.3万余条;

2026年3月,北京市网信办启动的“清朗京华·AI向善”专项行动,针对AI色情、假冒他人侵权信息、虚假谣言、去标识等问题进行系统整治,督导平台强化AI生成合成内容识别、审核、处置能力。

可以看出,网络生态治理正在完成从“事后处置”转向“规则先行、源头预防”、从“运动式整治”迈向“长效机制建设”的关键转型,覆盖内容生态、平台运营、算法机制与数据安全等关键领域。

平台成为关键变量

制度提供的是边界与方向,而真正决定治理效果的,是平台如何落地执行。

以小红书为例,4月27日,小红书举办首届AI治理开放日,首次完整输出对AI的治理主张,呈现出三条较为清晰的实践路径:

小红书鼓励AI作为创意放大器,释放灵感;

反对AI作为造假工具与低质内容生产机器;

所有AI生成合成内容需主动标识。

AI治理主张摘录

在具体实践中,平台并未简单以“是否使用AI”作为判断标准,而是强调内容是否具备真实信息增量与审美价值。例如,一位专攻宋代院体画的创作者,将手绘作品与AI动态生成结合,在坚持“人主导、机辅助”的前提下拓展艺术表达。这类实践表明,AI可以成为创意放大器,而非内容污染源。

与此同时,平台也在划定清晰边界:禁止AI仿冒他人、虚构经历进行营销、批量化账号运营、低俗魔改经典内容等。

这种“鼓励创新+明确禁区”的双轨机制,本质上是对内容生产逻辑的再校准。

在技术层面,小红书采用“用户主动标注+系统自动识别”的标识机制,核心在于保障用户知情权与选择权,并通过申诉机制避免误伤正常创作。

过去平台更多依赖删除、限流或封禁等事后治理手段,而现在是规则前置,什么可以做、什么不能做,一开始就说清楚,治理思路从被动修补向主动建构升级。此外,AI内容治理没有标准答案,每个平台定位不同,应该寻找适合自己的治理体系。

平台力量是关键,但不是万能的。在平台发力的同时,也需推动内容治理、数据安全、算法监管协同发力,构建政府监管、平台履责、社会监督、用户自律的多方共治体系。

毕竟,AI内容治理不只是技术问题或平台问题,也是国家治理体系现代化的重要组成部分。

重建信任是根本问题

在AI重塑内容生产的时代,最稀缺的资源不再是内容本身,而是信任。当“真假难辨”成为常态,用户对信息环境的基本信任一旦受损,再高效的内容生产也难以转化为真实价值。平台主动划定边界,本质上是在维护这种信任基础。

技术本身并无善恶。AI既可以放大创意、丰富表达,也可以制造幻觉、堆积噪音。关键在于制度如何设定边界,平台如何引导方向。治理的核心就是让技术在规则之内有序运行、向善发展。

当真实的信息、真实的表达、真实的情感能够持续被看见,流量才可能沉淀为“留量”,进一步转化为高质量发展的“增量”,这也正是网络生态治理长效机制所要实现的目标。